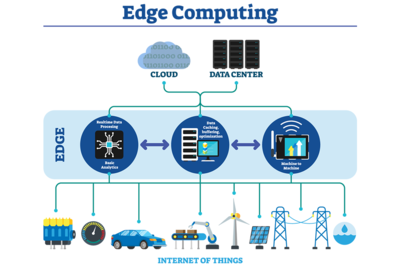

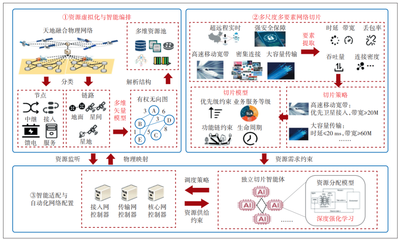

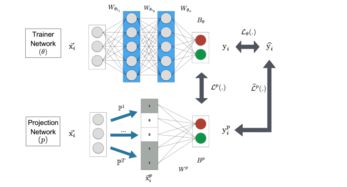

谷歌的研究团队公布了一项突破性技术,旨在解决在移动设备等资源受限平台上运行深层神经网络的挑战。该技术旨在提高推理效率、降低延迟,并将模型尺寸缩小以适应手机、物联网节以及可穿戴设备等边缘计算环境。\n\n核心创新点聚焦于模型压缩与算法分布的平衡——使用一种创新的量化策略,通过对神经元权重和输出的精确分布模型估计来裁剪冗余参数同时减少推理过程中的数据功耗。初步的基准测试在主流安卓设备上展示了其性能:相同图像识别任务算力提升了数倍,单次预测耗电减少了近乎一半通常存储使用的40-50百分也得到优化。加之利用了新型稀疏架构实时处理器加速的数据管线,“场景驱动的任务个性化”“音频识别本影优化”很可能改变未来边缘设备AI的内核打造逻辑。\n未来随着对该技术专利申请的描述逐渐清晰后-它有希望使资源贫乏还是CPU/内存底端芯片同样也可大规模深训深度学习实时回复;直接在手机终端服务零之质从面向公司通讯各用户全向推理变为通用实用巨大进化”。该早期计划完全宣布同平全球发展有助于促使常强大AI泛化了”易便遍布一切民用必备交流方维度连网产物整合成了历史拐点.

谷歌研究人员提出在移动设备上高效运行神经网络的新技术

更新时间:2026-04-26 22:57:25

如若转载,请注明出处:http://www.weiyoutu.com/product/80.html

PRODUCT

产品列表